Verantwortungsvoll mit künstlicher Intelligenz umgehen

Viele Konsumenten sind sich nicht bewusst, welche digitalen Fussabdrücke sie hinterlassen – und was mit diesen Daten passiert. Strassenszene in Kuba. (Bild: Keystone)

Künstlicher Intelligenz (KI) begegnen wir täglich. Dazu, wie wir mit diesen Anwendungen umgehen, machen wir uns aber nur wenige Gedanken. Denn meist ist uns ihre Wirkungsweise nicht bekannt – und auch nicht, wie wir durch sie beeinflusst werden. Ob es Empfehlungen zu Produkten in Onlineshops oder Stellenangebote sind: Beides scheint auf den ersten Blick unverdächtig. Erst bei genauerem Hinsehen erkennen wir, dass hinter diesen scheinbar praktischen Empfehlungen Algorithmen stecken, die vermutlich nicht nur unsere Interessen vertreten und auch Fehlern unterliegen können.

Künstliche Intelligenz ist nicht fehlerfrei

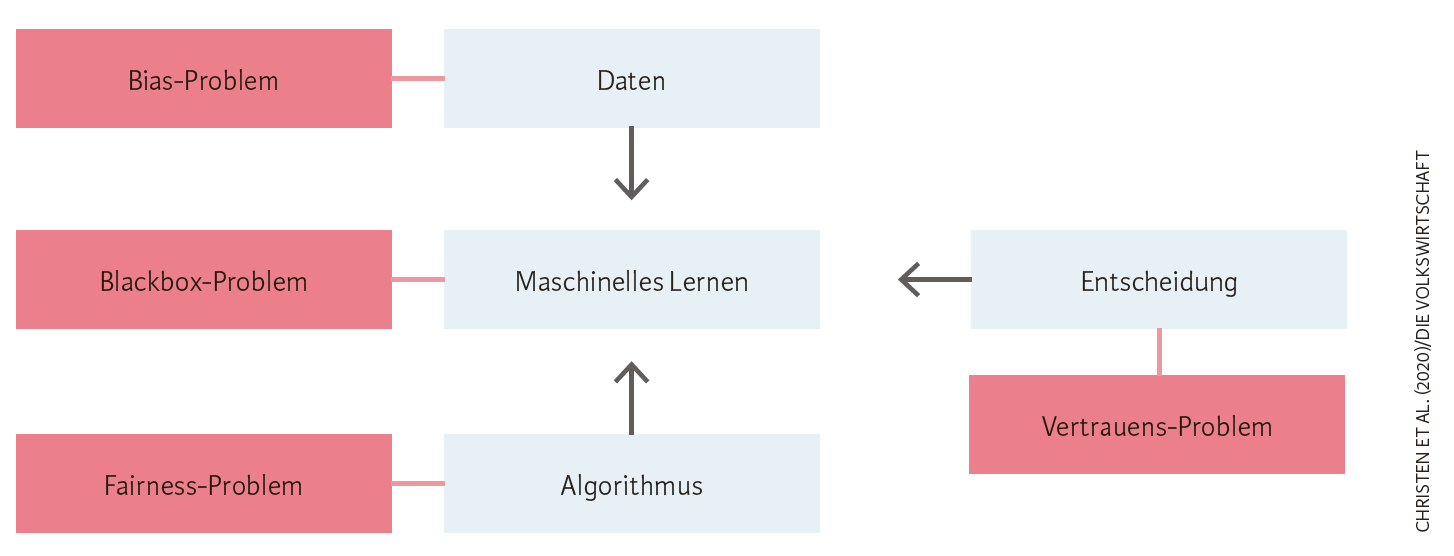

Grundprobleme von KI-Anwendungen sind evident (siehe Abbildung).[1] Erste Schwierigkeiten ergeben sich bereits durch die Analyse und die Daten selbst. Fehlerhafte Daten oder deren Verarbeitung können nämlich zu Diskriminierung führen. Deshalb spricht man auch von einem Bias-Problem. So können beispielsweise einzelne Personengruppen in Bewerbungsverfahren benachteiligt werden. Den Nutzern, in diesem Fall den Bewerbern, fällt dieser Bias nicht auf, weil sie die Funktionsweise des Algorithmus nicht kennen.

Ein weiteres Problem kommt hinzu, wenn es sich um lernende Algorithmen handelt, die sich laufend verändern. So kann es sein, dass es – selbst für die Entwickler des Algorithmus – nicht mehr nachvollziehbar ist, wie der Algorithmus genau zu seiner Entscheidung gekommen ist. Bei diesem sogenannten Blackbox-Problem entzieht sich uns durch die Komplexität der Abläufe ein klares Verständnis des Algorithmus.

Zudem existiert ein sogenanntes Fairness-Problem. Denn bei der Entwicklung von Algorithmen können auch normative Annahmen der Entwickler einfliessen. Werte und Interessen können gegenüber anderen bevorzugt werden. Anders als beim Bias-Problem sind es hier Annahmen des Entwicklers und nicht des Algorithmus, die zum Problem werden.

Diese Probleme zeigen die Grundproblematiken auf, denen KI-Systeme unterliegen. Dennoch kommt es vor, dass Menschen diesen Systemen mehr vertrauen als ihren Mitmenschen. Oder umgekehrt: Menschen vertrauen anderen Menschen mehr, obschon Algorithmen in bestimmten Fällen objektiver entscheiden würden. Darauf macht uns das Vertrauensproblem aufmerksam, das wir bei jeder Anwendung hinterfragen müssen.

In einer Studie im Auftrag der Schweizer Stiftung für Technologiefolgen-Abschätzung (TA-Swiss) haben wir gemeinsam in einem interdisziplinären Team in den Bereichen Arbeit, Konsum, Bildung und Forschung, Medien und öffentliche Verwaltung untersucht, welche Chancen und Risiken mit der Anwendung von KI verknüpft sind und welche Grundprobleme dabei entstehen können. In diesem Artikel beschränken wir uns auf die Bereiche Arbeit und Konsum und betrachten insbesondere die wirtschaftspolitischen Aspekte, die sich daraus ergeben.

Vier Probleme von künstlicher Intelligenz, die zu ethischen Fragen führen

Angst vor Arbeitsplatzverlust

Mit dem technischen Fortschritt sind seit je Veränderungen der Arbeitswelt verbunden. Diesbezüglich bedeutet KI hier einen Quantensprung. Denn sie kann den Menschen bei Tätigkeiten unterstützen oder ihn sogar bei Aufgaben ersetzen, die bislang menschlicher Intelligenz vorbehalten waren. Es ist daher nicht verwunderlich, dass dies grosse Sorgen um die Zukunft der Arbeit entfacht.

2013 hat eine Studie der Oxford-Wissenschaftler Frey und Osborne geschätzt, dass rund 47 Prozent aller Berufe durch die Computerisierung gefährdet sind, und hat so alte Debatten wiederbelebt.[2] Viele Nachfolgestudien haben versucht, diese Rationalisierungspotenziale zu bestätigen oder zu widerlegen. Einerseits wurde auf historische Entwicklungen verwiesen, denen zufolge Automatisierungswellen langfristig zu steigender Beschäftigung führten.[3] Andererseits wurde angezweifelt, ob dieser Vergleich legitim sei, denn der heutige Fortschritt zeichne sich durch eine ganz neue Qualität aus.[4]

Veränderte Arbeitswelt

Damit die Angst vor Arbeitsplatzverlusten nicht zum Innovationshemmnis wird, muss die Gesellschaft über den Einsatz von KI bestimmen und dabei eine faire Verteilung der Vorteile im Auge behalten. Das betrifft insbesondere die Möglichkeiten, Arbeit zu finden und Einkommen zu erzielen. Verantwortungsvolle Unternehmen und die Politik müssen dafür sorgen, dass die Substituierung menschlicher Arbeit durch KI-Systeme nicht zu Arbeitslosigkeit und damit verbundenen Einkommensverlusten führt. Die durch Covid-19 hervorgerufene Wirtschaftskrise macht ein entsprechendes Handeln dringender denn je. Entwicklungen, die mit dem KI-Einsatz über Jahre zu erwarten gewesen wären – massive Arbeitsplatzverluste und ein Einbruch einzelner Sektoren –, sind innerhalb weniger Wochen Realität geworden. Welche konkreten Massnahmen getroffen werden, um das sowohl für eine wirtschaftliche Erholung als auch für eine friktionslose Nutzung von KI-Technologien so notwendige Vertrauen wiederherzustellen, ist auf politischer Ebene zu entscheiden.

Die möglichen makroökonomischen Auswirkungen der digitalen Transformation im Allgemeinen und von KI im Speziellen – insbesondere die immer zahlreicheren Möglichkeiten, menschliche Arbeit zu ersetzen – sollten deshalb zum Anlass genommen werden, gesellschaftliche Debatten über Anpassungsprozesse anzustossen: Soll beispielsweise bei lang anhaltenden hohen Arbeitslosenraten die Regelarbeitszeit entsprechend reduziert werden? Wie können arbeitsrechtliche und soziale Standards bei immer flexibleren Arbeitsbedingungen in Zukunft gewahrt bleiben? Wie kann ein Auseinanderklaffen der Lohnschere verhindert werden? Und welche Weiterbildungsmöglichkeiten müssen geschaffen werden, um sowohl die individuellen Chancen zu erhöhen als auch die Entwicklung und Nutzung von KI zu fördern?

Kaum Kritik bei Konsum

Während ein Einsatz von KI in der Arbeitswelt oft mit Vorbehalten verbunden ist, ist er im Konsumbereich bereits weit vorangeschritten. Schon seit Langem werden durch den Einsatz von KI beispielsweise attraktive Kundensegmente identifiziert, detaillierte Kundenprofile erstellt und Angebote personalisiert. Um Kosten einzusparen und die Effizienz zu steigern, werden gerade durch Tech-Giganten wie Google, Amazon, Facebook und Apple stetig bessere KI-Systeme an der Schnittstelle zum Kunden entwickelt und zum Einsatz gebracht. Konsumenten begegnen KI damit heute tagtäglich – mehr oder weniger bewusst. Sei es, wenn Google Maps den kürzesten Weg nach Hause anzeigt, Amazons Empfehlungssystem weitere Produkte zum Kauf empfiehlt, Facebooks Newsfeed Inhalte sortiert oder Apples Sprachassistent Siri fliessend mit einem interagiert.

Die Vorteile derartiger KI-Systeme liegen auf der Hand: Unternehmen profitieren einerseits von Prozessautomatisierungen, z. B. in der Werbeplanung und -platzierung, und Kosteneinsparungen, indem z. B. immer natürlicher wirkende KI-Assistenten und Chatbots eingesetzt werden, um häufige Kundenanfragen zu beantworten. Auf der anderen Seite können sie ihre Effizienz steigern, indem Konsumenten gezielt angesprochen und Angebote kundenindividuell zugeschnitten werden.

Auch Konsumenten profitieren von solch personalisierten Informationen: Vermeintlich weniger interessante Inhalte und Angebote werden ausgeblendet und Konsum- sowie Kaufentscheidungen durch diese Vorauswahl weitgehend unterstützt, aber auch beeinflusst. Gerade in Zeiten der Informationsüberflutung begrüssen viele Kunden diese Personalisierung. Konsumenten sollten sich dabei aber auch möglicher Bias- und Fairness-Probleme bewusst sein (siehe oben) und KI-Systemen daher nicht blind vertrauen.

Durch die wachsende Anzahl digitaler Fussabdrücke findet eine dynamische Personalisierung von Kundenprofilen heute meist statt, ohne die Konsumenten nach ihren Vorlieben zu befragen. Einige Hundert Likes auf Facebook sind so schon ausreichend, um sensible Persönlichkeitseigenschaften mit hoher Genauigkeit zu schätzen.[5] Gerade weil diese Systeme ohne aktives Zutun der Konsumenten funktionieren, bleiben KI-Systeme eine intransparente Blackbox. Für Konsumenten wird es daher immer schwieriger, einzuschätzen, welche Schlüsse KI anhand ihrer Daten ziehen kann (inferred data) und wo sie KI überhaupt begegnen. So wussten 2015 in einer US-Studie beispielsweise 62 Prozent der Facebook-Nutzer nicht, dass der Newsfeed durch KI personalisiert wird.[6]

Unternehmen, welche KI-Systeme im Konsumbereich nutzen, empfehlen wir deshalb, den KI-Einsatz transparent zu machen und einfach zu vermitteln, welche Personendaten in das System einfliessen und welche Aussagen damit gemacht werden.

The winner takes it all

Aktuell unterstützen die meisten KI-Systeme die Konsumenten noch in eng definierten Bereichen. Experten erwarten jedoch, dass sich einige wenige KI-Assistenten wie Googles Assistant, Apples Siri oder Amazons Alexa durchsetzen werden, welche die Konsumenten über ganze Lebensbereiche hinweg unterstützen. Anstatt spezialisierter Assistenten für Gesundheitsfragen oder zur Terminkoordination könnte so in Zukunft ein Assistent Konsumenten in einer Vielzahl von Aufgaben unterstützen. Dies scheint auf den ersten Blick vorteilhaft. Da diese Systeme jedoch umso genauer werden, je mehr Daten eines Nutzers verfügbar sind, können langfristig für Konsumenten hohe Kosten entstehen, wenn sie den Anbieter wechseln. Das bedeutet, dass sich im Gegenzug auch für die Unternehmen steigende Markteintrittsbarrieren ergeben, sollten für sie keine Nutzerdaten verfügbar sein, um eigene KI-Systeme entsprechend zu trainieren. Die Nutzerdaten werden damit zunehmend zum neuen Treibstoff des digitalen Zeitalters. Um einem derartigen Datenkapitalismus zu entgehen, müssen nachhaltige Lösungen gefunden werden.

Deshalb soll gemäss unseren Empfehlungen geprüft werden, wie bei KI-Systemen die sogenannte Datenportabilität umgesetzt werden kann. Dabei kann ein Kunde bei einem Wechsel des Anbieters seine Kundendaten mitnehmen. Das würde den Anbieterwechsel erleichtern. Dabei ist zu prüfen, inwieweit neben den Rohdaten auch Daten bzw. Aussagen portabel sein sollen, welche durch ein KI-System erarbeitet wurden (inferred data).

Bewusstsein schaffen

Die gesellschaftliche Debatte über Arbeitsplatzverlust sowie die Forderung nach Transparenz und Datenportabilität verdeutlichen, wie relevant es ist, dass die Öffentlichkeit informiert ist und aktiv in Entscheidungen zu Einsatz und Umgang mit KI eingebunden wird.

Damit die Bürger mehr Kontrolle über ihre Daten bekommen, braucht es umfangreiche Bildungs- und Forschungsmassnahmen. So muss etwa das Bildungssystem alle Altersstufen auf den Umgang mit KI vorbereiten. Dazu soll untersucht werden, welche spezifischen Kompetenzen vermittelt werden müssen, damit die Lernenden ein allgemeines Verständnis der Fähigkeiten und Grenzen von KI-Systemen erhalten. Entsprechende Erkenntnisse sollen in Lehrmittel einfliessen und auf bestehenden Plattformen für Lehrkräfte und Lernende zur Verfügung stehen.

Ein Beispiel dafür, wie der Umgang mit KI an Schulen vermittelt werden kann, ist das sogenannte Computational Thinking. Diese Fähigkeit macht komplexe Problemstellungen und die Grundfunktionsweise von KI-Anwendungen bewusst und ermöglicht den Lernenden einen verantwortungsvollen Umgang mit KI. Solche Fähigkeiten schaffen zudem die Voraussetzung, um in der heutigen Arbeitswelt bestehen und als Arbeitnehmer vom KI-Einsatz profitieren zu können.

Auch Entwickler sind gefordert

Neben dem Bildungswesen steht auch die Forschung in der Pflicht. Sie muss an Lösungen für vertrauenswürdige KI-Anwendungen arbeiten. An Hochschulen, insbesondere in technischen Disziplinen, die sich mit der Entwicklung neuer KI-Systeme beschäftigen, sollen auch nicht technische Kompetenzen wie Nachhaltigkeit und Ethik gefördert werden. Dies soll sicherstellen, dass auch normative Zugänge, die in die Entwicklung von KI-Anwendungen einfliessen, sich an verantwortungsvollen und ethischen Prinzipien orientieren.

Damit die Vorteile von KI überwiegen, muss man sich also der Grundprobleme annehmen. Ein wichtiger Schritt dazu ist ein gemeinschaftlicher und informierter Diskurs über die Chancen und Risiken von KI, der unbedingt zu fördern ist.

Literaturverzeichnis

- Autor, D. H. (2015). Why Are There Still So Many Jobs? The History and Future of Workplace Automation. In: Journal of Economic Perspectives 29(3): 3–30.

- Christen, M., Mader, C., Cas, J., Abou-Chadi, T., Bernstein, A., Braun Binder, N., Dell’Aglio, D., Fábián, L., George, D., Gohdes, A., Hilty, L., Kneer, M., Krieger-Lamina, J., Licht, H., Scherer, A., Som, C., Sutter, P., Thouvenin, F. (2020). Wenn Algorithmen für uns entscheiden: Chancen und Risiken der künstlichen Intelligenz. In: TA-Swiss Publikationsreihe (Hrsg.): TA 72/2020. Zürich: vdf.

- Christen, M. (2019). Wie programmiert man ethische Intuition? In: Die Volkswirtschaft, 12/2019, 13–15.

- Eslami, M., Rickman, A., Vaccaro, K. et al. (2015). I Always Assumed That I Wasn’t Really That Close to [Her]: Reasoning About Invisible Algorithms in the News Feed. CHI 2015, ACM Press.

- Frey, C. B. und M. A. Osborne (2013). The Future of eEmployment: How Susceptible Are Jobs to Computerisation? In: Technological Forecasting and Social Change, 114: 254–280.

- Lovergine, S. und A. Pellero (2018). This Time It Might Be Different: Analysis of the Impact of Digitalization on the Labour Market. In: European Scientific Journal, ESJ, 14(36): 68.

- Youyou, W., Kosinski, M. und Stillwell, D. (2015). Computer-based Personality Judgments Are More Accurate than Those Made by Humans. In: Proceedings of the National Academy of Sciences, 112(4): 1036–1040.

Bibliographie

- Autor, D. H. (2015). Why Are There Still So Many Jobs? The History and Future of Workplace Automation. In: Journal of Economic Perspectives 29(3): 3–30.

- Christen, M., Mader, C., Cas, J., Abou-Chadi, T., Bernstein, A., Braun Binder, N., Dell’Aglio, D., Fábián, L., George, D., Gohdes, A., Hilty, L., Kneer, M., Krieger-Lamina, J., Licht, H., Scherer, A., Som, C., Sutter, P., Thouvenin, F. (2020). Wenn Algorithmen für uns entscheiden: Chancen und Risiken der künstlichen Intelligenz. In: TA-Swiss Publikationsreihe (Hrsg.): TA 72/2020. Zürich: vdf.

- Christen, M. (2019). Wie programmiert man ethische Intuition? In: Die Volkswirtschaft, 12/2019, 13–15.

- Eslami, M., Rickman, A., Vaccaro, K. et al. (2015). I Always Assumed That I Wasn’t Really That Close to [Her]: Reasoning About Invisible Algorithms in the News Feed. CHI 2015, ACM Press.

- Frey, C. B. und M. A. Osborne (2013). The Future of eEmployment: How Susceptible Are Jobs to Computerisation? In: Technological Forecasting and Social Change, 114: 254–280.

- Lovergine, S. und A. Pellero (2018). This Time It Might Be Different: Analysis of the Impact of Digitalization on the Labour Market. In: European Scientific Journal, ESJ, 14(36): 68.

- Youyou, W., Kosinski, M. und Stillwell, D. (2015). Computer-based Personality Judgments Are More Accurate than Those Made by Humans. In: Proceedings of the National Academy of Sciences, 112(4): 1036–1040.

Zitiervorschlag: Mader, Clemens; Cas, Johann; Scherer, Anne (2020). Verantwortungsvoll mit künstlicher Intelligenz umgehen. Die Volkswirtschaft, 24. Juli.